Urgensi Literasi Deepfake: Ketika Mata Tak Lagi Bisa Dipercaya

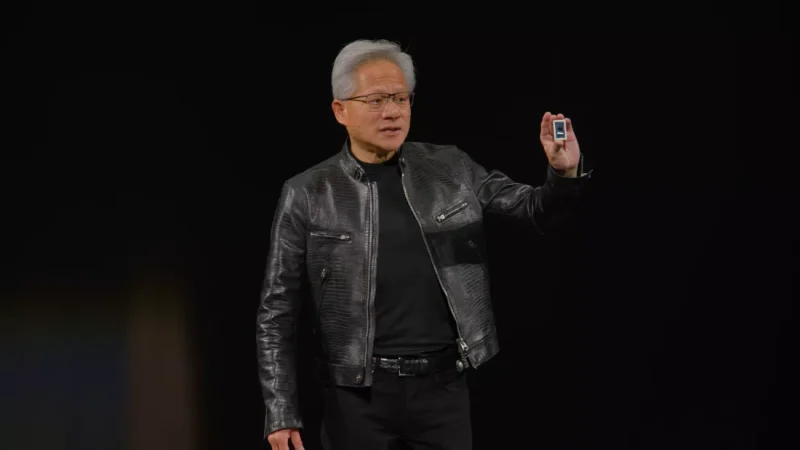

Fenomena gambar dan video palsu hasil kecerdasan buatan (AI) — yang lebih dikenal sebagai deepfake — kini telah melewati batas yang dulu cuma jadi bahan hiburan. Kita sudah tidak lagi berbicara soal meme lucu atau eksperimen teknologi di forum daring; ini sudah berubah menjadi ancaman nyata terhadap sesuatu yang paling mendasar dalam kehidupan digital kita: kepercayaan.

Kalau dulu masih bisa dibedakan antara video asli dan palsu dari gerakan bibir yang agak kaku atau kedipan mata yang tidak alami, sekarang semua itu sudah tidak relevan. Deepfake modern mampu meniru detail terkecil dari wajah, bayangan, bahkan intonasi suara dengan presisi yang nyaris sempurna. Manusia tak lagi bisa membedakan mana yang benar-benar nyata.

Baca juga: Rekomendasi Laptop AI 10 Jutaan: ASUS Vivobook 14 M1407KA

Table of Contents

Senjata Pemusnah Kepercayaan

Perkembangan AI generatif membuat deepfake bukan sekadar kecanggihan teknologi, tapi juga alat manipulasi yang sangat berbahaya. Bayangkan menjelang pemilu, muncul video “calon presiden” yang terlihat meyakinkan sedang membuat pernyataan provokatif — padahal itu hasil rekayasa. Butuh berapa jam sampai video itu viral, dan seberapa cepat kerusakan sosial yang ditimbulkannya?

Deepfake sudah menjadi senjata ampuh untuk disinformasi politik, penipuan digital, bahkan penghancuran reputasi pribadi. Di sisi lain, ancaman terhadap keamanan siber juga makin meningkat. Dengan kemampuan meniru wajah atau suara seseorang, pelaku kriminal bisa melewati sistem verifikasi biometrik, menipu bank, atau bahkan berpura-pura menjadi atasan lewat panggilan video.

Dan yang paling berbahaya dari semuanya adalah efek jangka panjangnya: erosi kepercayaan publik terhadap media. Ketika video bukan lagi bukti yang sahih, orang mulai ragu pada semua yang mereka lihat — berita, testimoni, bahkan bukti kriminal. Skeptisisme yang ekstrem ini bisa menciptakan dunia di mana tidak ada yang benar-benar bisa dipercaya.

Antara Teknologi dan Literasi

Perusahaan besar seperti Google dan YouTube memang sedang mengembangkan sistem pendeteksi deepfake berbasis AI. Tapi ini ibarat menambal perahu bocor di tengah badai. Setiap kali sistem deteksi diperbarui, teknologi pembuat deepfake juga ikut berevolusi. Ini adalah perlombaan senjata digital yang tidak akan pernah benar-benar selesai.

Solusi yang lebih realistis bukan hanya mengandalkan alat pendeteksi, tapi juga membangun literasi digital di tingkat masyarakat. Kita harus belajar ulang cara “melihat” dunia digital — bukan sekadar mempercayai, tapi memverifikasi apa yang kita lihat.

Saatnya Belajar Curiga

Pemerintah, media, dan lembaga pendidikan perlu turun tangan. Bukan dengan sensor, tapi dengan pendidikan kritis: mengajarkan publik bagaimana deepfake dibuat, bagaimana mengenali kejanggalannya, dan bagaimana menahan diri untuk tidak langsung menyebarkan sesuatu hanya karena tampak meyakinkan.

Sikap curiga yang sehat harus menjadi bagian dari kebiasaan digital kita. Setiap kali sebuah video terasa terlalu emosional, terlalu ekstrem, atau terlalu sempurna untuk jadi kenyataan — mungkin memang bukan kenyataan.

Dunia di Mana Fakta Bisa Dipalsukan

Kita sedang hidup di masa ketika “melihat berarti percaya” sudah tidak berlaku lagi. Dan jika kita gagal beradaptasi, kendali atas narasi publik akan berpindah ke tangan mereka yang punya akses terhadap teknologi deepfake — bukan mereka yang punya kebenaran.

Literasi deepfake bukan lagi kemewahan. Ini adalah kebutuhan dasar di dunia digital yang terus kabur antara realitas dan rekayasa. Dan kalau kita tidak berhati-hati, masa depan bisa jadi akan diisi oleh kebohongan yang terlihat terlalu nyata.

VIDEO TERBARU MURDOCKCRUZ :